AIの話題

AIの話題「Perplexity」の意味は「困惑度」(言語モデルの予測精度)

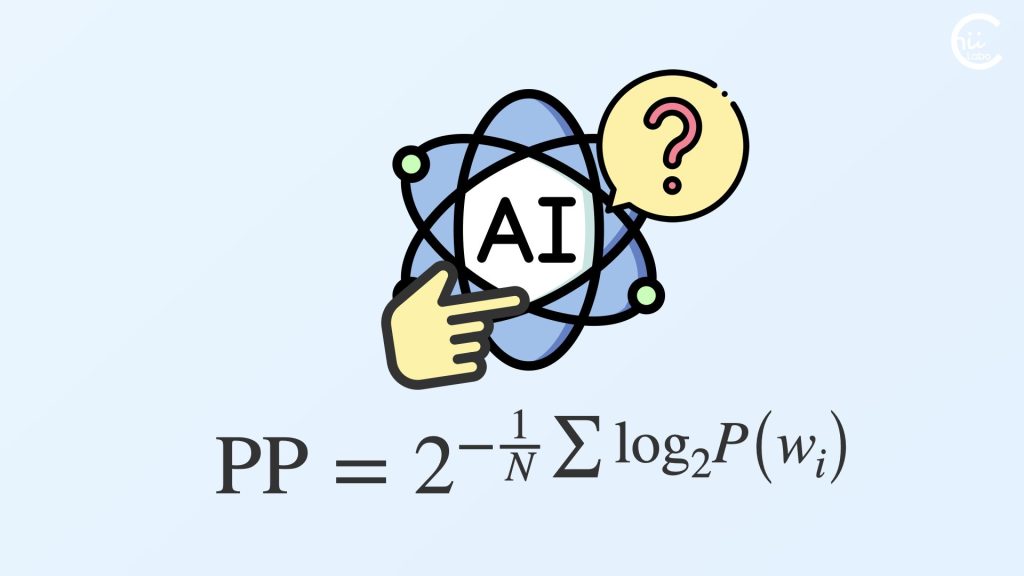

Perplexityは言語モデルが次の単語を予測する際の確信度を示す指標です。Perplexity値が小さいほど予測精度が高く、大きいほどモデルがデータセットに対して困惑している状態を表します。訓練データと検証データのPerplexity値を比較することで、モデルの学習状態や過学習の有無を確認できます。ラテン語の「per-plexus」もともと「Perplexity」は「困惑」という意味の言葉です。語源はラテン語の「perplexus」、「編み込まれた」「込み入った」に由来し...