- インターネットの情報は、アルゴリズムによって個人の好みに合わせて表示されています。

- この仕組みにより、同じ価値観を持つ人々が集まり、特定の意見が増幅される「エコーチェンバー現象」が起きています。

- 暗黙的に選別するレコメンドエンジンの強化学習を理解して、必ず複数の多様な情報源で確認する意識が大切です。

1. エコーチェンバー・フィルターバブル

私たちは毎日、SNSやウェブサイトを通して大量の情報に触れています。

しかし、すべての情報を見ることはできないため、機械的に選別されたものを見ています。

このような選別には、「暗黙の偏り」がある点に注意する必要があります。

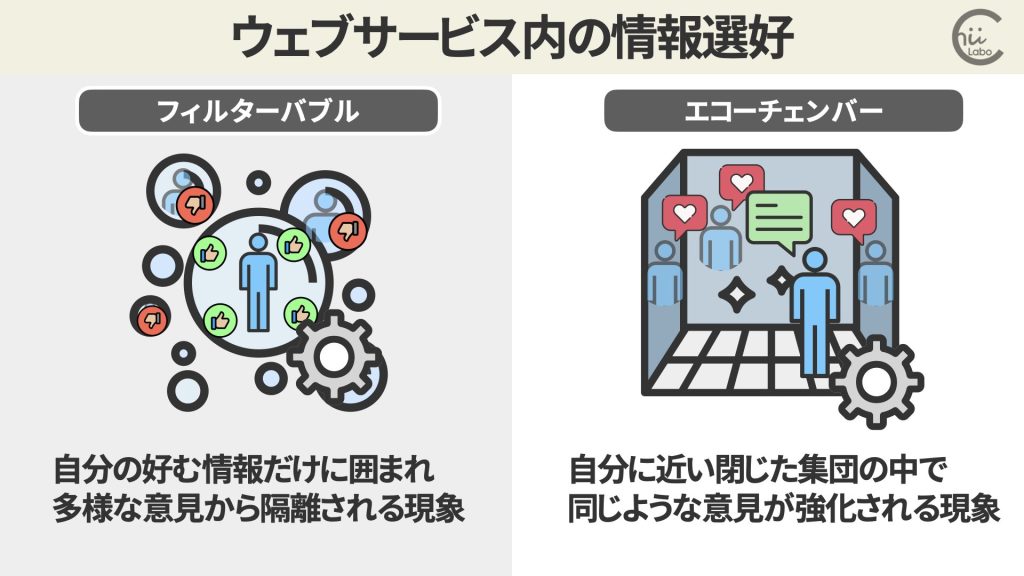

「フィルターバブル」とは、インターネット上で検索アルゴリズムやSNSのフィルタリングによって、自分の趣向に合った情報だけが表示される現象を指します。

これは、私たちを「見えない泡(バブル)」で包み込み、異なる視点や意見から遮断してしまう効果があります。

「エコーチェンバー」は、同じような考えを持つ人々が集まり、特定の意見や信念が繰り返し共有され増幅される現象です。

SNSでは、同じ価値観を持つ人々が自然とつながりやすく、その結果として「閉じた情報空間(反響室:echo chamber)」が形成されやすくなっています。

YouTubeやInstagramなどは、たくさんの人が同じサービスを使っているけど、実は一人ひとり見えている風景が違うんだよね。

つい、そこで多い情報は、ついみんなが見ている「当たり前」と勘違いしやすいんだよね。

1.1. レコメンドエンジンという「仕掛け」

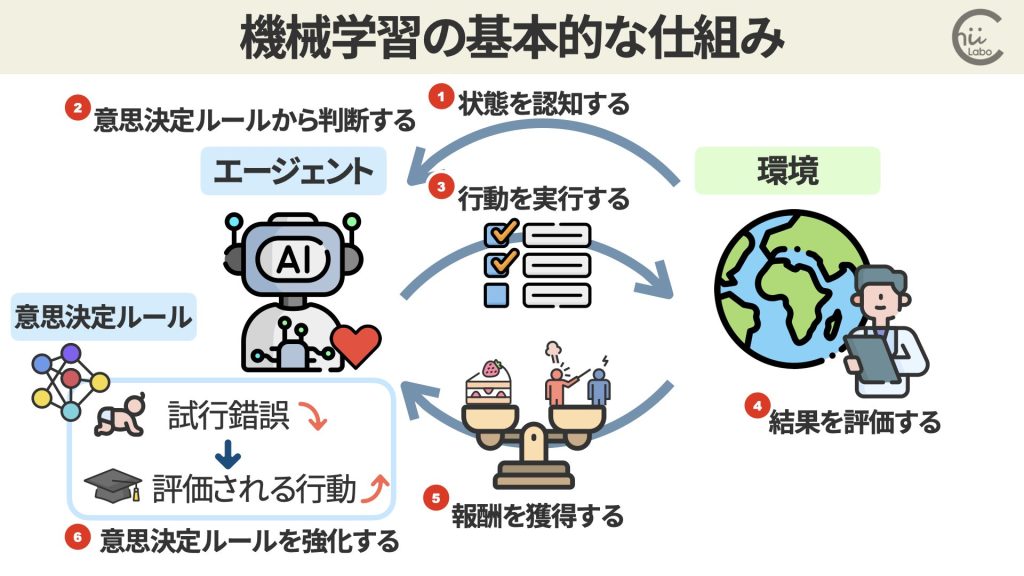

SNSやショッピングサイトには、コンテンツを提示する「レコメンドエンジン(推薦システム)」があります。

「レコメンドエンジン」は、ユーザーの関心を引き、長時間サービスに留まってもらうことが重視されます。

現代のインターネットサービスが、「アテンションエコノミー(注目経済)」の原理で動いているからです。

たくさんのユーザーが長時間利用することが、消費や広告収益に結びついています。

サービスはユーザーの目を引く情報を表示しようと、死にもの狂いの工夫をこらしています。

2. 個人の認知が歪む(パーソナライズと強化学習)

この便利な仕組みには「落とし穴」があります。

自分の考えに合う情報ばかりに触れることで、その考えがますます強化され、異なる意見を受け入れにくくなってしまうのです。

- 人間には生来、自分の信念や価値観を支持する情報を重視する「確証バイアス」があります。

- また、好ましい情報を積極的に選んで接触する「選択的露出」の傾向も持っています。

しかし、パーソナライズされた情報環境は、これらの認知バイアスをさらに強化してしまいます。

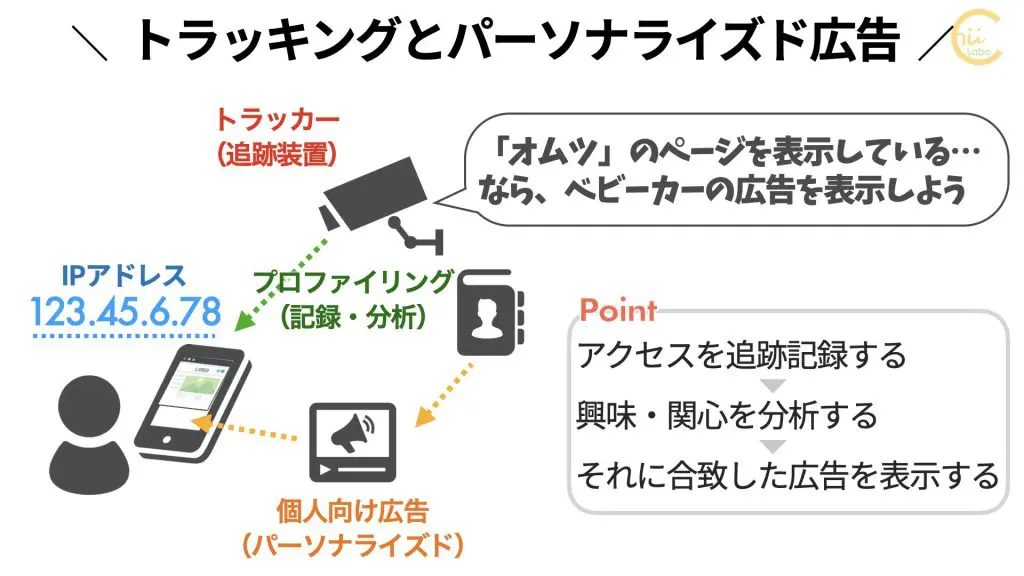

![[iPhone] メールプライバシーは保護するべき?【パーソナライズド広告】](https://chiilabo.com/wp-content/uploads/2022/05/image-32-10.jpg)

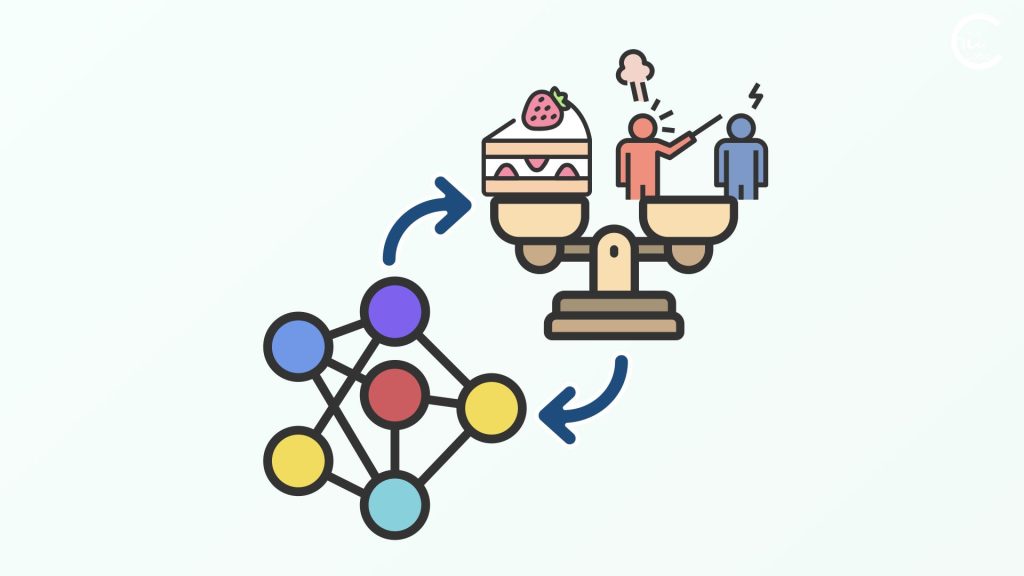

「パーソナライズ」は、私たちの興味関心により関連性の高いコンテンツを提供するために、強化学習モデルを用いてユーザーの興味を予測しています。

このプロセスでは、明示的なフィードバック(「いいね」など)と暗黙的なフィードバック(閲覧時間など)の両方が考慮されます。

つまり、レコメンドエンジンが判断の拠り所にするのは、私たちの「既存の行動・興味」、つまり過去のデータです。

そのため、新しい視点や思いがけない発見との出会いが徐々に減ってしまうのです。

なんかAIに甘やかされているみたいで、気持ち悪いね。

砂糖みたいな情報は、甘くて欲しくなるけど、食べ過ぎに注意。

2.1. 集団における情報の増幅と伝播(シェア・インフルエンサー)

この認知のゆがみは個人に留まらない点にも注意が必要です。

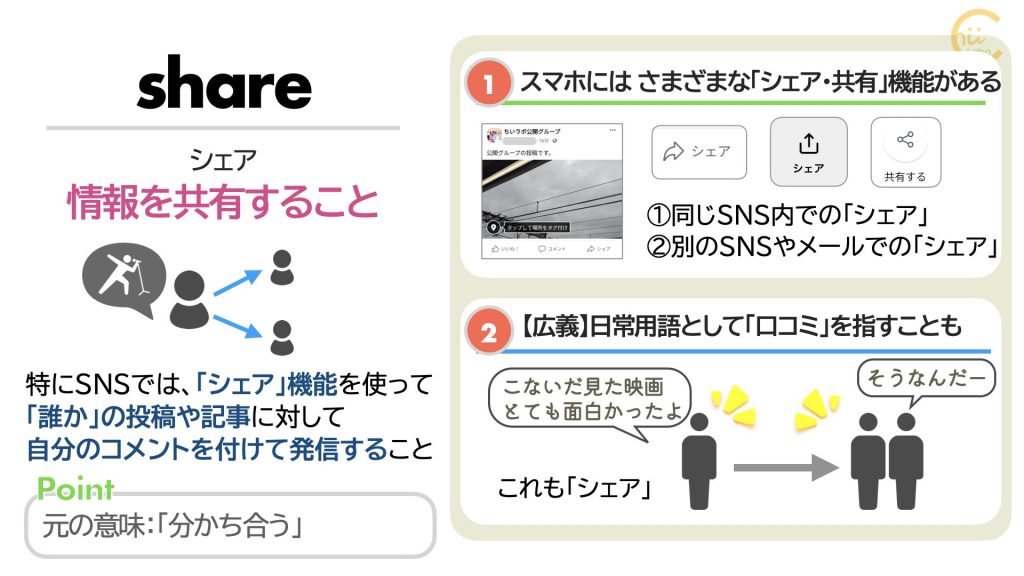

とくにSNSの「フォロー」や「シェア」の仕組みによって、集団の中で伝播・増幅されてしまうのです。

とくに、「SNS上の人気者」の発信は、情報共有の「起点」として大きな影響力を持つことになります(インフルエンサー)。

- 人は集団の中で、周囲の意見や行動に合わせようとする「社会的同調性」を持っています。

- また、他者の行動に影響されて同様の選択をする「情報カスケード」も発生します。

「レコメンドエンジン」は、新聞やテレビなどの「編集・校正」などと対比できます。

確かに、人の関与する編集や校正は「人為的」だとも言えます。

それに対して、レコメンドエンジンは一見、人が関与していない分「公平」で「客観的」に見えます。

ところが、実は機械学習によって「調整」されたものなのです。

![SNSの「ハッシュタグ」とは? [TwitterとTV・ラジオ番組]](https://chiilabo.com/wp-content/uploads/2022/01/image-16-1024x576.png)

3. 社会の分断とメディアリテラシー

エコーチェンバーとフィルターバブルは、社会の分断を深める要因となっています。

SNS上では、これらの現象がより顕著に表れやすいです。

特定の意見や情報が急速に広がって集団を形成し、同時に異なる意見を持つ集団間の対話が減少し、相互理解が困難になっています。

この課題に対応するには、以下のような取り組みが重要です:

- アルゴリズムの影響を理解し、適切にコントロールする

- 定期的に自分の情報環境を見直す

- 多様な情報源に意識的に触れる

- 批判的思考力を養う

- 異なる意見を持つ人々との建設的な対話を心がける

情報技術が発展を続ける中で、これらの課題への対応はますます重要になっていくでしょう。

私たち一人一人が、より開かれた情報環境を目指して意識的に行動することが求められています。