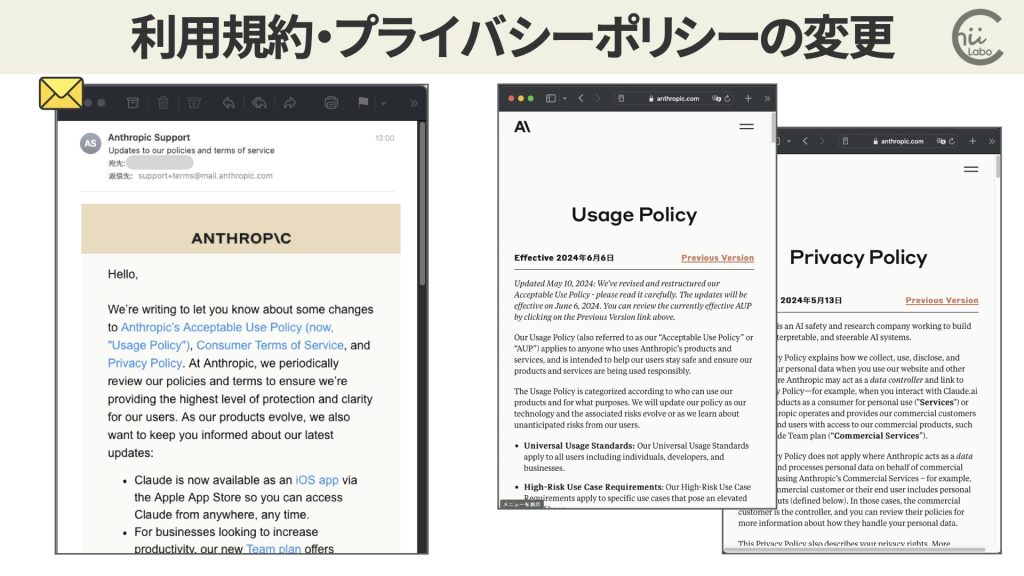

- Anthropicから利用規約などの変更のお知らせが届きました。

- 勤務先のメールアドレスで登録しているアカウントは、AIを個人的に利用する 場合にプライバシーが守られない可能性について注意喚起されています。

- また、API利用したチャットボットがユーザーに人間だと誤解されないように示すルールも加わるなど、適切な利用に向けた取り組みが進んでいるようです。

1. 「Updates to our policies and terms of service」

Anthropicから利用規約とプライバシーポリシーの変更についてのメールが届きました。

- 差出人:Anthropic Support<support+terms@mail.anthropic.com>

- 件名:Updates to our policies and terms of service

個人ユーザーにとっては、主なポイントは以下の3点です。

- ClaudeのiOSアプリが公開された

- デフォルトのデータ保持期間が30日に変更された

- 勤務先メールアドレスでClaude.aiアカウントを作成した場合の注意点が利用規定で明確になった

1.1. 勤務先メールアドレスのアカウントではAIを個人利用しない方がよい

勤務先のメールアドレスで登録すると、どんな問題があるの?

たとえば、生成AIの利用履歴が勤務先から見ることができる可能性もあるからです。

すでに企業用メールアドレスでClaude.aiアカウントを持っている場合、個人的に生成AIを利用するときには、別に個人のメールアドレスで作成することがおすすめです。

多くの企業では、業務に関連して従業員が作成したデータは組織に帰属するという方針を取っています。

Claude.aiのアカウントで登録したメールアドレスが勤務先の所有するメールドメインのものの場合(例: taro.yamada@company.com)、そのアカウントは個人用ではなく職務用のアカウントとみなされる可能性があります。

つまり、勤務先や所属組織がアカウントへのアクセス権を有したり、利用状況を監視したり、アカウントを停止・削除したりする権利を持つ可能性があるのです。

反対に、個人的に生成AIを使っているときに不適切な利用があった場合には、会社や組織に迷惑をかけるリスクもあります。

アカウントが停止されるだけでなく、責任問題に発展することもありえます。

勤務先のメールドメインでアカウントを作成する際は、所属組織の規定も確認しておきましょう。

1.2. そのほかの利用規約・プライバシーポリシーの主な変更点

- Claudeなどを使ってサービス提供をする場合に、自身のユーザーにAIシステムとのやり取りだと開示する要件を追加した

- ビジネス向けの新しいチームプランが登場した

- 危害のリスクが高い特定の「高リスクユースケース」を新たに定義した

- データ処理の委託先としてAmazon Web Servicesを追加しました。

2. 「人間のふり」をさせる使い方はダメ

そのほかの変更点で興味深いのは、「AIシステムとのやり取りだと開示する要件」の追加です。

- 顧客向けのチャットボットなど、外部に公開されるAIエージェント

- 未成年者にAnthropicのAPIを組み込んだ製品を提供する場合

たとえば、生成AIのAPIを利用して、自動応答するチャットサービスやバーチャルアイドルの配信サービスなどが設計できます。

そのようなサービスを提供するときには、ユーザーに誤解を与えないために「AIシステムとのやり取り」だと示すルールが追加されました。

つまり、「人間のふり」をしてはダメということです。

3. EUとAnthropicアイルランド

もう一つのトピックは、EUでの扱いに関するものです。

- Claude.aiがEUユーザーにも提供開始された

- EEA、英国、スイスのユーザーのデータ管理者が、Anthropicアイルランドに変更されました

- 英国の消費者向けに、契約主体がAnthropicアイルランドに変更されました

EUにはGDPR(一般データ保護規則)という世界で最も厳しいプライバシー保護法があり、またAIの倫理的な利用について活発な議論が行われています。

Claude.aiをEUで提供するためには、利用規約を整備して、データの収集や処理、保管などでGDPRに準拠する必要があったでしょう。

生成AIを社会の中に取り入れていくために、技術面だけでなくルール面の整備も少しずつ進んでいるんですね。

![[Claude 3] Anthropicから利用規約などの変更のお知らせメールが届いた(社会的受容のためのルール整備)](https://chiilabo.com/wp-content/uploads/2024/05/image-10-17-1024x576.jpg)

![[Electron]今日の日付カレンダーアプリを作った(Calectron)](https://chiilabo.com/wp-content/uploads/2024/05/image-13-59-1024x576.jpg)