- ユーザーの質問に対する生成AIの回答を傍受すると、暗号化されていても単語の長さが推測できたようです。

- しかも、単語の長さの情報だけでも、データ解析によってある程度AIの回答内容を復元できたそうです。

- これは、生成AIがリアルタイムに回答を表示するために、細切れにデータを送信する性質が原因になっています。

「解読可能」であっても実際には条件が厳しいので、ふつうに生活していたら、そこまで気にする必要はないです。

ただ、生成AIとのやり取りは、たとえ通信が暗号化されていても、外部から見られてしまう危険性があることは知っておくとよいです。

1. 単語の長さだけで元の文章が推測できる

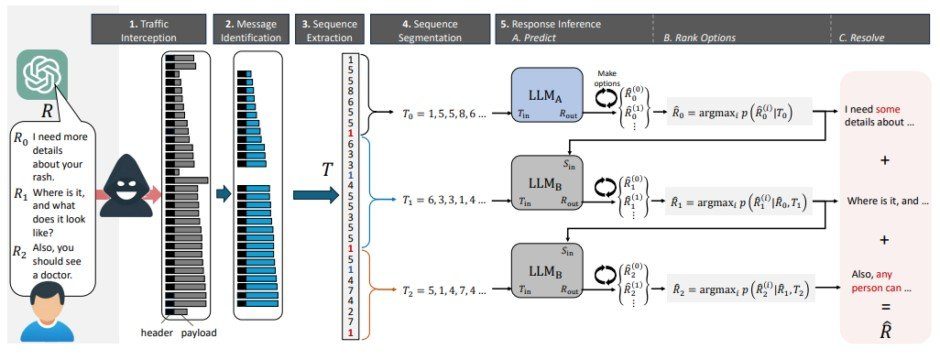

生成AIがユーザーの質問に回答する際、文章は単語や文字ごとにトークン化され、個々のトークンが連続的にユーザーに送信されます1。

イスラエルの研究チームは、生成AIから送信されている個々のデータパケットのサイズから、単語の長さを推測できることに気づきました2。

さらに、単語の長さの情報を手掛かりに大規模言語モデル(LLM)で解析すると、生成AIの回答内容をある程度 推測できることがわかりました。

つまり、攻撃者は、ユーザーと生成AIの通信を傍受し、送信されるデータのサイズからトークンの長さを推測します。

そして、その情報をAIで解析することで、生成AIの回答内容を復元するのです。

実験では、回答の29%を正確に再現し、55%はトピックを類推できたそうです。

通常は通信が暗号化されていれば、内容を傍受されることはありません。

しかし、この攻撃では暗号化された情報なのに、外部の攻撃者が回答内容を盗み見ることができてしまいました。

もし、生成AIと機密情報をやり取りしていたら、外部に情報漏洩してしまう危険性があるのです。

まぁ、そもそも生成AIに機密情報をそのまま送るのはやめておいた方がよいですよね。

壁に耳あり、障子に目あり。

2. 生成AIの回答とメールなどの違い(リアルタイム)

暗号の解読みたいだね。

これって、電子メールとかでも危ないの?

一般的なメッセージのやり取り(電子メールなど)では、事情が異なります。

というのも、通常は単語ごとにリアルタイムで送信されることはないからです。

メッセージ全体を一度に暗号化して送信するので、この手法では単語の長さを推測できません。

一方、主にChatGPTやCopilotなどの生成AIの場合、リアルタイム性を重視するためにトークンを個別に送信する仕組みになっています。

これが、独特のパターンを悪用されやすいわけです。

ふーん。

ということは、今みたいなリアルタイムで回答を生成する方法は、まとまった文章ができてから送るように変わるかもしれないんだね。

![[LINE] レターシーリングはどんなセキュリティなの?(共通鍵交換と暗号化)](https://chiilabo.com/wp-content/uploads/2024/03/image-11-7-1024x576.jpg)

(補足)

- 厳密には、トークンは必ずしも単語や文字とは一致しません。トークンは、単語の一部や記号なども含む可能性があります。

- 他人がGPT-4とやりとりしたテキストを盗む攻撃 成功率50%以上 イスラエルの研究者らが発表:Innovative Tech – ITmedia NEWS

![[Windows] メモリ消費している見つけにくいプロセスを探す(RAMMap)](https://chiilabo.com/wp-content/uploads/2024/03/image-14-11-1024x576.jpg)